AI Geletterdheid Training

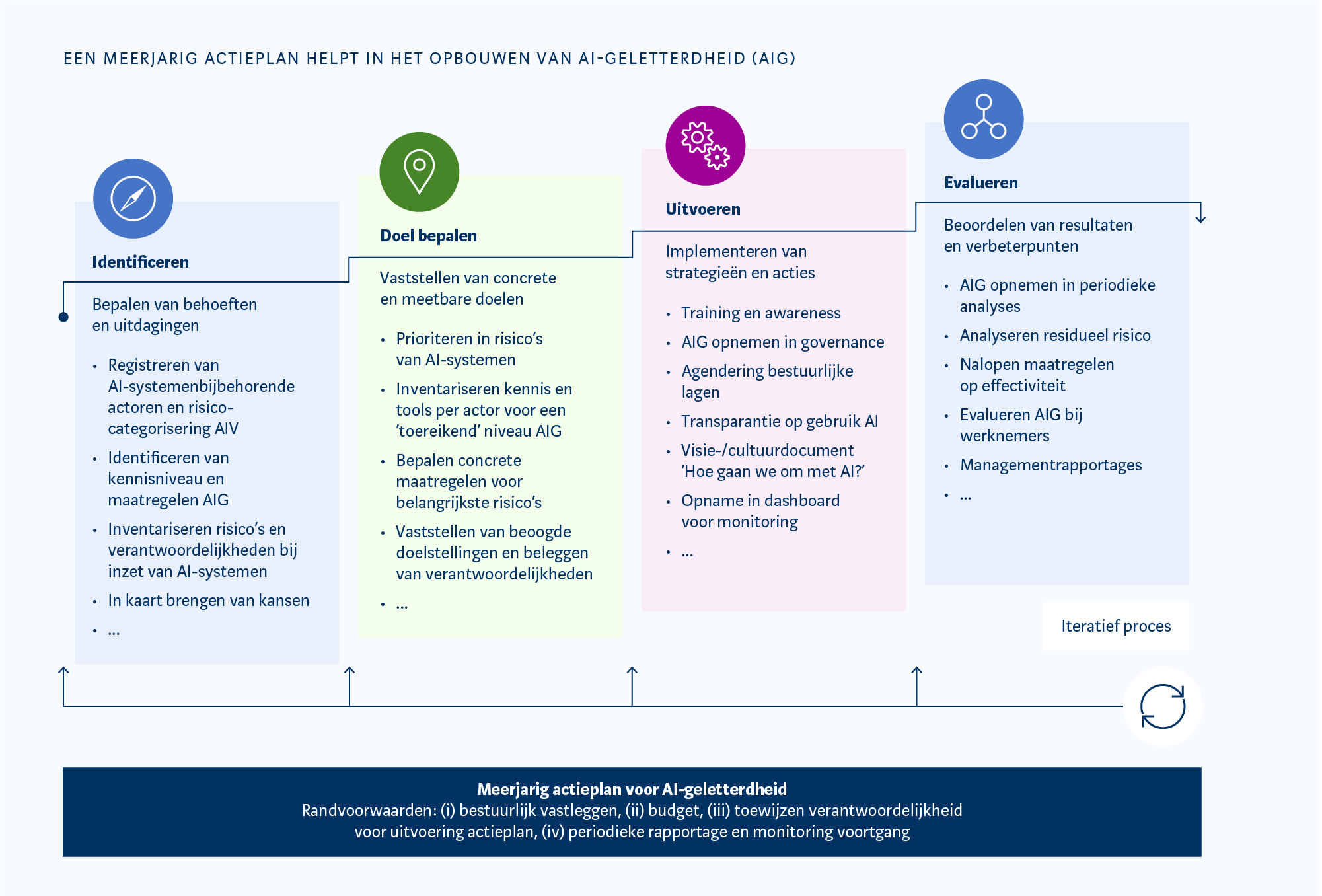

Een strategische training gebaseerd op het officiële AP (Autoriteit Persoonsgegevens) actieplan voor AI-geletterdheid. Deze training helpt uw organisatie om systematisch AI-geletterdheid op te bouwen volgens de bewezen 4-fasen aanpak: Identificeren, Doel bepalen, Uitvoeren en Evalueren. Van wettelijke compliance tot praktische implementatie, alles wat u nodig heeft voor verantwoorde AI-inzet.

EU AI Act compliance: Sinds 2 februari 2025 eist de Europese AI Act aantoonbare AI‑geletterdheid voor iedereen die met high‑risk‑AI werkt. Recruiters die cv‑screeners gebruiken, bankiers die kredietmodellen managen, zorgteams die triage‑apps draaien: allemaal hebben ze dezelfde plicht — begrijpen wat de algoritmen doen, welke fouten ze kunnen maken en hoe je die rechtzet.

Onze eendaagse training legt precies dat fundament. We bouwen de sessie modulair op: één gezamenlijke kern en sector‑deep‑dives in aparte break‑outs. Zo krijg je maatwerk zonder dat je vijf aparte workshops hoeft te boeken.

AI-risicozones per Sector: EU AI Act Prioriteiten

Onderstaande tabel toont welke sectoren prioriteit hebben in het kader van de EU AI Act, en waarom juist deze sectoren specifieke aandacht nodig hebben voor AI-compliance.

| Prioriteit | Sector / domein | Reden (“waarom nu?”) | Typische high-risk use-cases (Annex III) |

|---|---|---|---|

| Tier 1 | Financiële diensten (banken, verzekeraars, fintech) | Zware EU-toezichtskaders (EBA, DORA); reputatierisico | Krediet-scoring, transactie-monitoring, biometrische KYC |

| Gezondheidszorg & med-tech | MDR-koppeling; patiëntveiligheid | Diagnose-ondersteuning, AI-triage, robot-chirurgie | |

| Publieke sector (ministeries, gemeenten, uitvoeringsinstanties) | Politieke druk op transparantie; aanbestedingseis voor AI Act-compliance | Kans-taxaties (toeslagen), crowd-monitoring, chatbot-diensten | |

| HR-tech / Recruitment-diensten | Annex III benoemt expliciet AI in werving & selectie | CV-screening, video-analyse, performance-tracking | |

| Kritieke infrastructuur (energie, transport, lucht- & spoor) | Veiligheidscomponent → direct high-risk | Predictive maintenance, verkeers-sturing | |

| Tier 2 | EduTech / Hogescholen & universiteiten | Annex III onderwijssystemen → high-risk | Proctoring, adaptief leren |

| Manufacturing & logistiek | Snelle AI-adoptie; OSHA- & CE-eisen | Vision-inspectie, autonome voertuigen | |

| Tier 3 | Scale-ups die generatieve-AI producten bouwen | IP-risico's & brand reputation | Chat-co-pilots, content-generatie |

Sectorspecifieke Workshops

Ontdek hoe onze training is afgestemd op verschillende sectoren en welke specifieke uitdagingen we per sector behandelen.

HR & Recruitment – daar begint de kettingreactie

De Uitdaging

Waarom juist hier? De wet noemt selectie‑AI expliciet, omdat een fout algoritme iemand letterlijk buiten de arbeidsmarkt kan plaatsen. Recruiters zijn daarmee de eerste defensielinie tegen bias én de eerste die beboet worden als ze hun dashboard blind vertrouwen.

De Aanpak

Hoe ziet de training eruit? We starten met een live bias‑scan op jullie eigen cv‑filter: twintig anonieme profielen, één rankingmodel, tien minuten suspense. De uitkomst vormt de rode draad voor de rest van de ochtend. We bespreken transparantie naar kandidaten ("Je wordt gescreend door AI") en oefenen menselijke overrides – inclusief de log‑teksten die een auditor wil zien. Favoriete take‑away van eerdere deelnemers: het "explain‑sheet" waarmee recruiters in drie zinnen kunnen uitleggen waarom kandidaat X tóch werd afgewezen. Volgens Sanne Derksen, Head of Talent Acquisition bij een fintech‑scale‑up, "verdient die sheet zich op één dag terug in geloofwaardigheid bij kandidaten én hiring managers."

Finance – compliance is cultuur, AI voegt een nieuwe laag toe

De Uitdaging

Wat staat er op het spel? Krediet‑scorings‑ en anti‑fraudemodellen vallen als vanzelf in het high‑risk‑vakje. Boetes tot zeven procent van de wereldomzet klinken in boardrooms luider dan elke keynote over innovatie.

De Aanpak

Wat doen we in de break‑out? We brengen een fictief krediet‑model in storing: een bias‑alert op postcode 1092. De groep beslist live of het model pauzeert, hoe dat in de ISAE‑3402‑rapportage komt te staan en welke klant‑communicatie volgt. Tussendoor leren deelnemers hoe ze de AI‑Act‑documentatie koppelen aan bestaande risk‑frameworks, zodat er niet nóg een compliancelaag bovenop komt maar één geïntegreerd verhaal.

Zorg & Med‑tech – geen algoritme mag het vertrouwen van de patiënt breken

De Uitdaging

Waarom is de lat hier het hoogst? Een triage‑app of decision‑support‑tool kan het verschil maken tussen wel of niet behandelen. Fouten worden niet alleen met geld afgerekend, maar met reputatie en soms met levens.

De Aanpak

Hoe maken we het tastbaar? We simuleren een spoed‑scenario: de AI adviseert patiënten met milde klachten naar huis te sturen, maar de dienstdoende arts twijfelt. De groep doorloopt een realtime beslisboom: logbestanden openen, second opinion forceren, patiënt informeren. Daarna herleiden we de input naar concrete verbeter‑acties: aanvullende trainingdata, uitleg‑module voor verpleegkundigen en een escalatieknop voor artsen.

Publieke sector – transparantie is de default, niet de uitzondering

De Uitdaging

Het spanningsveld: strakke aanbestedingsregels, media‑gevoeligheid en een kritische burger. Een ogenschijnlijk simpele bewoners‑chatbot kan in de krantenkoppen belanden als hij juridisch advies geeft waar hij niet toe bevoegd is.

De Aanpak

De workshop‑essentie: We dissecteren een bestaande gemeente‑chatbot. In teamverband herschrijven we de openings‑boodschap ("Ik ben een AI‑assistent, geen jurist"), definiëren vertrouwen‑s‑grenzen en bedenken wat er gebeurt als het antwoord níet zeker is. Resultaat: een concrete blueprint van transparantie‑ en fallback‑regels die dezelfde dag nog live kan.

Kritieke infrastructuur – wanneer downtime geen optie is

De Uitdaging

Waarom extra spannend? Een verkeerde voorspelling in een predictive‑maintenance‑model kan een turbine stilleggen of, erger, mensen in gevaar brengen.

Kritieke infrastructuur omvat essentiële diensten en systemen zoals energie, water, transport, telecom en cybersecurity die onmisbaar zijn voor het functioneren van de samenleving. Deze sectoren vallen automatisch in de hoogste risicocategorie van de EU AI Act vanwege de maatschappelijke impact bij verstoringen.

De Aanpak

Wat we doen: We leggen een denkbeeldige storing voor: plotselinge temperatuurs‑piek, het model twijfelt. De groep beslist of de asset offline gaat, hoe de incident‑log eruitziet en hoe de operator uitlegt waarom de AI in de war raakte. Daarmee botsen we meteen op de kernvraag van de AI Act: hoe leg je een black‑box‑model uit aan een menselijke operator?

Wat u gaat leren

AP Stap 1: Identificeren

- Inventariseren van alle AI-systemen binnen uw organisatie

- Uitvoeren van risicobeoordeling per AI-systeem

- In kaart brengen van betrokken personen en hun rollen

- Nulmeting van AI-kennis en vaardigheden medewerkers

AP Stap 2: Doel bepalen

- Vaststellen van doelen en prioriteiten op basis van risiconiveau

- Bepalen van benodigde kennis per medewerker en rol

- Ontwikkelen van cultuurvisie en AI-strategie document

- Toewijzen van organisatorische verantwoordelijkheden

AP Stap 3: Uitvoeren

- Implementeren van bewustwordingstrainingen en specialisatietrainingen

- Ontwikkelen van AI-beleid en gebruiksrichtlijnen

- Uitvoeren van praktische acties per doelgroep

- Creëren van bestuurlijk commitment en budget

AP Stap 4: Evalueren

- Opzetten van evaluatiemethoden: rapportages, audits en nulmetingen

- Analyseren van effectiviteit van genomen maatregelen

- Implementeren van continue verbeteringsacties

- Bijstellen van doelen en maatregelen op basis van resultaten

Wat levert het u op?

Wat u kunt verwachten

Voorproefje van de AI Geletterdheid Training

Bekijk enkele slides uit de training om een indruk te krijgen van wat u kunt verwachten. Gebaseerd op het officiële AP (Autoriteit Persoonsgegevens) actieplan voor AI-geletterdheid.

AP Framework: Strategische AI-geletterdheid

AI-geletterdheid volgens de Autoriteit Persoonsgegevens: een strategische en langdurige aanpak om menselijke regie te waarborgen bij de verantwoorde inzet van AI-systemen.

Waarom AI-geletterdheid essentieel is

Vanaf 2 februari 2025 moeten organisaties AI-geletterdheid waarborgen. Dit betekent dat personeel de juiste vaardigheden, kennis en begrip heeft om AI-systemen verantwoord in te zetten.

- Versterkt maatschappelijke weerbaarheid

- Ondersteunt organisaties bij verantwoorde AI-inzet

- Biedt basiskennis voor strategische keuzes

- Helpt risico's mitigeren en kansen benutten

- Waarborgt menselijke controle en toezicht

AP 4-Fasen Aanpak

- Identificeren: Inventariseer AI-systemen en risico's

- Doel bepalen: Stel concrete doelstellingen vast

- Uitvoeren: Implementeer strategieën en acties

- Evalueren: Analyseer resultaten en verbeterpunten

Wettelijke Verplichting

- EU AI Act artikel 4: AI-geletterdheid verplicht

- Aanbieders én gebruikers zijn verantwoordelijk

- Toereikend niveau afhankelijk van context

- Technische, sociale én ethische aspecten

Uw Trainer

Zahed Ashkara

AI Enablement Specialist & Trainer

Als oprichter van Embed AI combineert Zahed zijn expertise in AI-implementatie met een passie voor organisatietransformatie. Hij helpt organisaties bij het strategisch en verantwoord integreren van AI door middel van een holistische enablement aanpak.

Met zijn achtergrond in zowel strategie, governance als praktische AI-implementatie begeleidt hij organisaties bij het opbouwen van AI-competenties, het creëren van de juiste cultuur, en het implementeren van governance structuren die innovatie mogelijk maken.

Zahed's unieke combinatie van strategisch inzicht, technische AI-kennis en praktische implementatie-ervaring maakt hem de ideale gids voor uw AI-transformatie. Zijn pragmatische aanpak zorgt ervoor dat u niet alleen kennis opdoet, maar deze ook daadwerkelijk integreert in uw organisatie voor blijvend succes.

Investering

Inclusief:

- Uitgebreide trainingsmaterialen

- Lunch en versnaperingen

- Certificaat van deelname

- Implementatieplan template

- Praktische handleidingen en checklists

- Naslagwerk en documentatie

Beschikbare Data

mei

juni

juli

augustus

Wat cursisten zeggen

“Ik vond de AI Geletterdheid cursus erg informatief en gemakkelijk te volgen. Het gaf een solide overzicht van hoe AI werkt, waar het wordt gebruikt, en enkele risico's en ethische kwesties om in gedachten te houden. Als internal auditor heeft het me geholpen te begrijpen hoe AI van invloed kan zijn op zaken als interne controles, gegevensverwerking en risicogebieden. Het heeft me zeker meer vertrouwen gegeven als het gaat om het bespreken van AI-gerelateerde onderwerpen op het werk. Een zeer nuttige cursus, absoluut aan te raden!”

“Zahed is een professionele en vaardige trainer, die met zijn inhoudelijke kennis en praktische aanpak de complexe onderwerpen goed weet te doorgronden en uit te leggen. Over de Europese AI Verordening is nog veel onduidelijk, maar de masterclass bracht helderheid met betrekking tot de wetgeving en de impact op ondernemingen. Ik heb een beter begrip van de risico categorisering voor AI-modellen en welke (wettelijke) vereisten hiermee samenhangen. De praktische insteek, gecombineerd met technologisch inzicht, maakt dit een waardevolle training die ik elke jurist aanraad te volgen.”